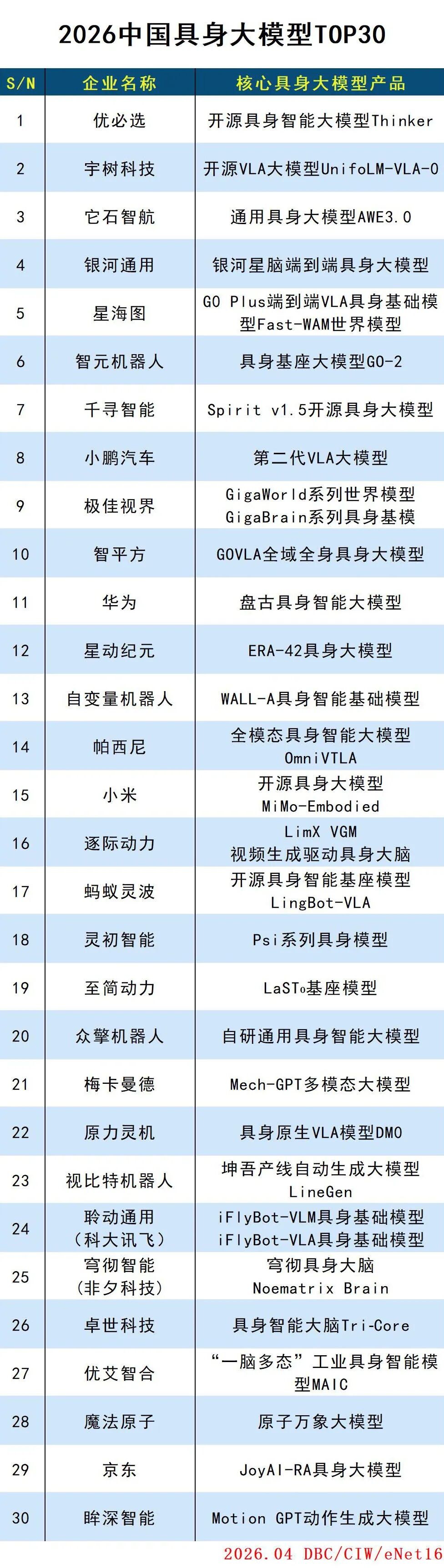

2026中国具身大模型TOP30

无数企业的叙事逻辑如出一辙:拿一套开源的通用大模型,接一个视觉识别模块,再套一个预设的机器人动作库,便对外宣称研发出了“端到端具身大模型”。这种玩法,本质上是给语言大模型装了一个远程遥控器,用数字世界的符号逻辑,去硬套物理世界的运行规则,从根上就走错了方向。

我们必须先厘清一个核心问题:具身大模型与通用大模型,从来不是同一物种,二者的底层逻辑有着本质鸿沟。

通用大模型是数字世界的原生智能,它的核心范式是“下一个token预测”,训练燃料是互联网上可无限复制的静态文本、图像数据,输出的是符号化的语言、图片与视频。它的运行环境是封闭的、确定的、无成本的,模型可以无成本地回溯、修正、迭代。

而具身大模型是物理世界的原生智能,它的核心范式是“下一个状态预测”,训练燃料只能来自真实物理世界中,带因果关系的、多模态的动作-反馈闭环数据。它的输出不是符号,而是连续的、可执行的、必须适配物理规则的动作序列;它的运行环境是开放的、不确定的、有极高成本的,一次动作失误,就可能导致设备损坏、产线停摆,甚至人员受伤,每一次试错都有真实的物理代价。

这种本质差异,决定了二者的技术路线从根源上就完全不同。2026年被行业称为“具身原生元年”,核心标志就是行业终于达成共识:真正的具身大模型,必须摒弃“大模型改装”的外挂思维,构建“感知-行动”紧耦合的原生闭环。